統計においてはp値や信頼区間が必ず出てきます。そこで、基本となる仮説検定(hypothesis testing)や信頼区間(confidence interval)について解説します。

仮説検定

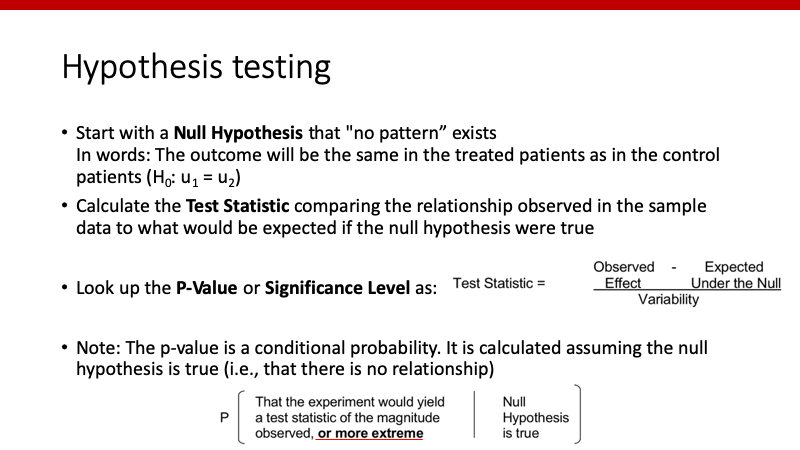

まず、「何のパターンもない」という帰無仮説(H0: Null hypothesis)をたて、その条件下で今回の研究データを元にtest statisticを計算します。正規分布とprobabilityで解説したように、統計学ではそれぞれの分布におけるtest statistic(ex. 正規分布におけるZ-score、t-分布におけるt-score)のprobabilityを知ることができます。そのscoreまたはそれよりもextremeな値をとりうる確率が、p値です。

簡単にいえば、「差がない」という条件下で今回のような差またはそれ以上の差を生む確率が、p値です。したがって、その解釈は以下のようになります。

1. もしp値が小さければ、帰無仮説の元、今回のような結果となる可能性が低い i.e. 帰無仮説を棄却(「差がない」という仮説を棄却)します。

2. もしp値が大きければ、今回のような結果は起こりうることである、i.e. 帰無仮説を棄却しない(「差がない」という仮説は間違ってない)

ということになります。

信頼区間

今回の研究結果から導き出した値は、あくまで今回対象とした集団の値です。我々の目的は、真の集団の値を知ることですが、それができないため今回の研究から真の値を推測することになります。

あなたの研究において、B群(n=100)と比較したA群(n=100)の腎不全に対するodds比が2.0であったとします。それは、あくまであなたの研究対象(n=200)においての値にすぎません。同様の研究(n=200)をもう一度おこなったら、少し違う値をとるでしょう。1.8かもしれませんし、2.3かもしれません。しかし、それもまた真の値ではありません。我々ができることは、今回の研究から、真の母集団を対象とした腎不全のodds比(真のodds比)を推測することです。その真の値があるであろう範囲、それが信頼区間です。

信頼区間の理解を深めるために

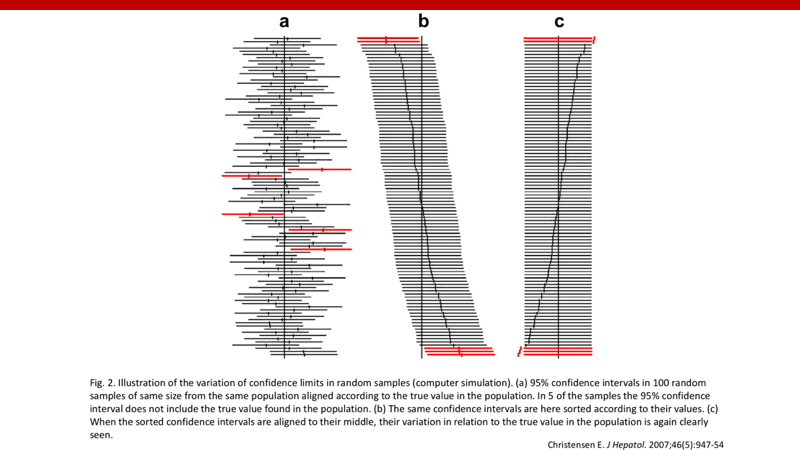

以下はシミュレーションです。母集団や真の値がわかっている状態(←ふつうはこんなことはありません)で、毎回その母集団からランダムにサンプリングして研究を行い、毎回その値(ex. odds比)と95%信頼区間を計算して並べた表です。100回サンプリングし、100回研究を行った際、その95回の研究における信頼区間は真の値を含んでいますが、5回は真の値を含まなかった、ということを表しています。これが95%信頼区間の意味です。

ちなみに、仮説検定と信頼区間は別物です。「oddsの信頼区間が1を含んでいなかったら有意差あり」などという表現を目にしますが、厳密には間違っています。信頼区間は検定しているわけではないので、p値をもちません。実際、計算上でどの群のvarianceを使うかによって、検定結果と信頼区間が一致しないことも(少ないですが、検定の種類によっては)ありえます。

コメント

コメント一覧 (5件)

[…] […]

[…] 連続変数同士に関連性があるかを調べるために、相関具合を表す相関係数と、関連性があるか否かを調べる検定を行います。検定の帰無仮説は、「両者に関連性はない」「両者は独立している」です。 […]

[…] 階層別の二者の関係性が、それぞれ異なっているか否かを判断します。統計学なので、できれば検定で判断したいですよね。そこで用いるのが、Breslow-Day testです。帰無仮説は「階層別の関係性が同じ」です。 […]

[…] […]

[…] 仮説検定と信頼区間:統計学を用いた検定の基本用語である、帰無仮説、p値、信頼区間について解説します。 […]