これまでは、”simple linear regression”と称して、説明変数Xは一つだけ(X1)の場合を考えてきました。今回は、説明変数をもう一つ(X2)を加えます。目標は

1. X2を加えたmodelを解釈できる。

2. X2をmodelに加えることで、係数(β1)やそのvarianceがどのように変化するかを理解する。

です。以上ができて初めて、因果推論を目標としたmodelを作ることが可能となります。Logistic regression modelでも基本的な考え方は同じなので、しっかりと理解しておきましょう。

では始めましょう。

1. 二つ目の変数(X2)を入れたmodelの解釈

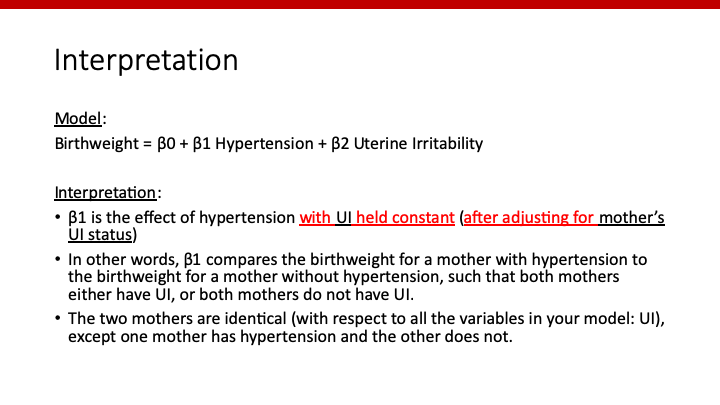

Outcome (Y)は、出生児の体重です。説明変数として、(母の)高血圧(X1)だけでなく、(母の)膀胱刺激症状(X2)の2つがmodelに入っています。この場合のβ1の解釈ですが、

膀胱刺激症状(X2)が一定である時、高血圧が無い場合(X1=0)と比較して高血圧がある場合(X1=1)の出生児体重(Y)の増加分がβ1

ということになります。この、「X2が一定(holding ~ constant)である時」ですが、「X2を調整(adjusting for ~)した時」と表現されることもあります。

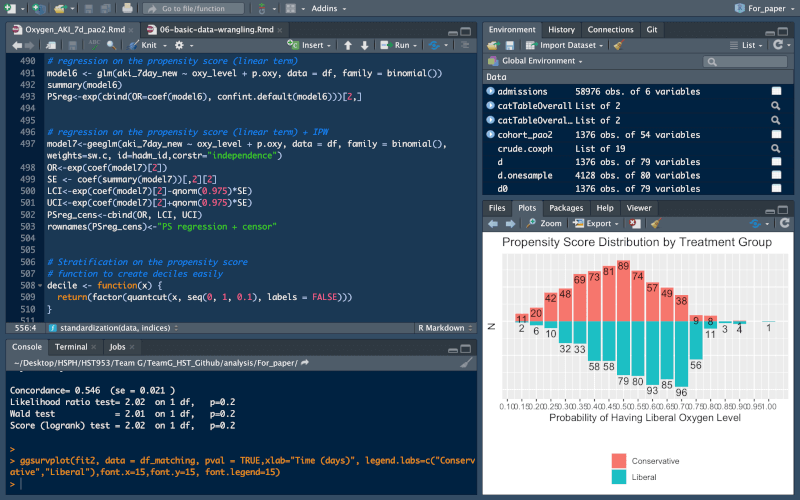

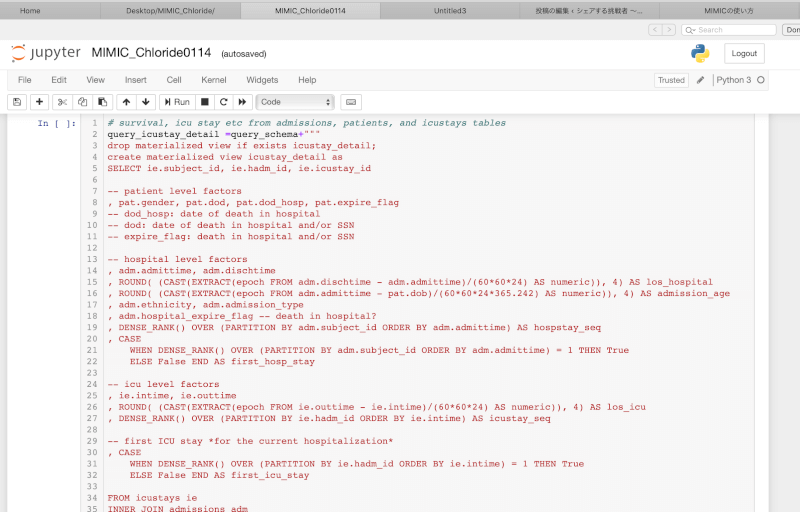

ちなみに、疫学者はこの「adjusting for」を嫌います。なぜなら、変数をadjustする方法はregressionだけでないからです。Propensity scoreやinverse probability weightingなど、他の変数をadjustする方法は沢山あります。どのように調整したかを明確にするためにも、「adjust」という言葉を使わず方法を明確に示せ、ということのようです。

今回は統計がメインなので、adjustという言葉を使わせてもらいます。

2. X2を入れることによる変化

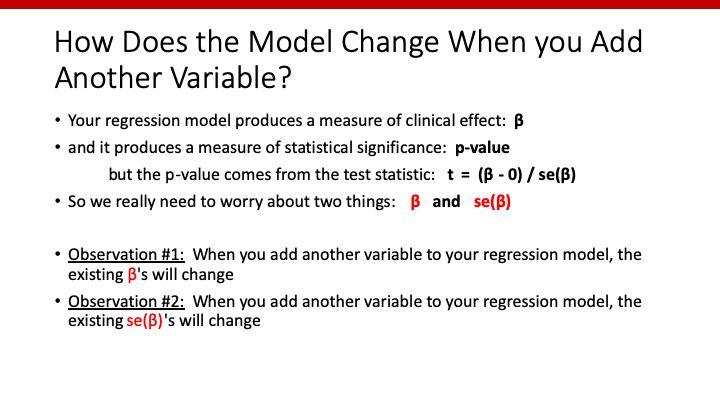

以前の記事で説明したように、regression modelでは、それぞれの変数Xの係数βと、そのstandard errorであるse(β)を用いて計算されたp-valueが知りたい値でしたね。

そして、説明変数が1つだけのsimple regression modelに、2つ目の変数を加えた場合、1つ目の変数の係数βや、そのstandard errorが変化します。それぞれの値だけでなく、この「変化」に注目することが大切になってきます。

β1の変化

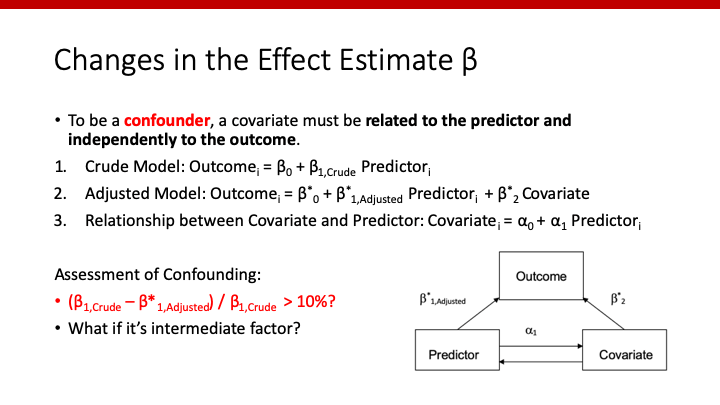

2つ目の変数X2をmodelに加えた際、1つ目の変数X1の係数β1が(加える前のβ1と比べ)変化することがあります。統計学的には、この変化率をconfounder (交絡因子)の定義に用いるため、まずはこの係数β1の変化に注目しましょう。

しつこいようですが、これは統計学的なconfounderの定義です。疫学的なconfounderとは異なります。知りたい方はこちらを読んでください。

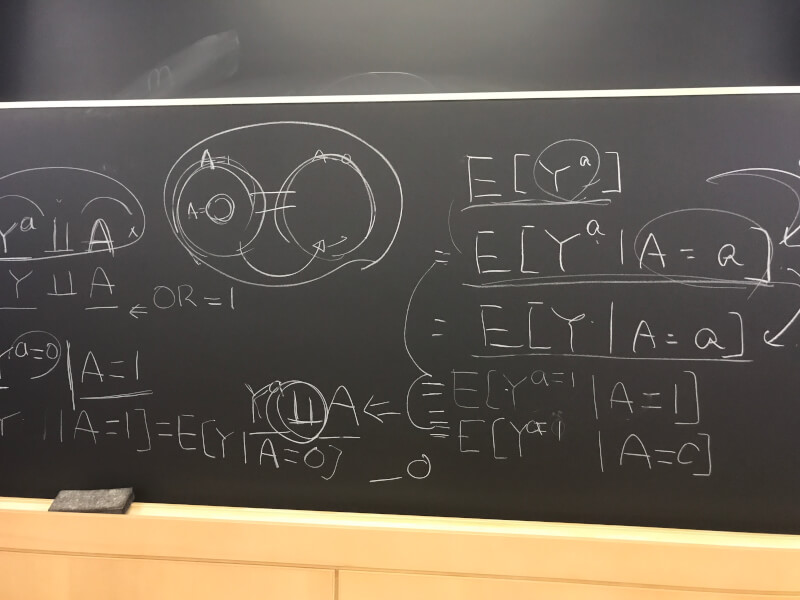

また、X2がintermediate factor、すなわち、DAGにおいて

X1 → X2 → Y

というケースも注意が必要です。これは、X1がYを引き起こす機序として、X2を介在しているケースです。この場合も、X2をmodelに入れることでβ1が変化しますので、この定義だけを用いると(本当はconfounderではなくintermediate factorなのに)confounderと間違ってしまうことになります。

β1のstandard errorの変化

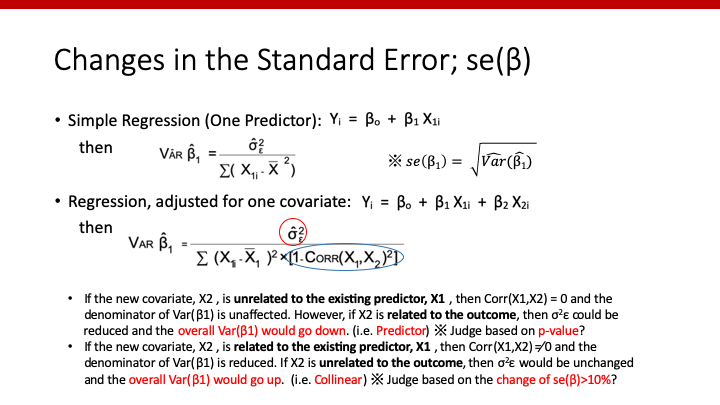

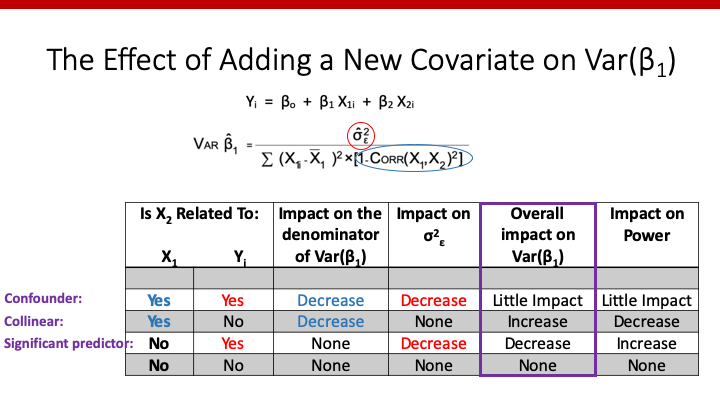

Simple regression modelにX2という変数を加えた場合のβ1のvariance(→”√”すればstandard error)は、上記のようになります。そして、βのstandard errorとその変化を観察することも、X2という因子を考える上で大切になります。

Simple regression modelにX2という変数を加えた場合のβ1のvariance(→”√”すればstandard error)は、上記のようになります。そして、βのstandard errorとその変化を観察することも、X2という因子を考える上で大切になります。

β1のstandard errorが低下

X2がX1と関係しておらず、Yのみと関連している場合は、X2はYを予測する上では非常に大切な変数ということになります。従って、X2をmodelに入れた場合、より良いmodelになるためMean Squared ErrorであるError Variance(赤丸の部分)は小さくなります。X2がX1と関連していなければ、correlation coefficient=0となり、青丸で囲んだ部分は大きくなります。すなわち、β1のvarianceは小さくなることがわかります。

後述のように、このようなX2を”significant predictor“と呼びます。

β1のstandard errorが増加

X2がX1と関係しているだけで、Yとは関連していない場合、X1とYとの関係を考える上ではX2は不要な変数ですよね。このような場合、X2をmodelに入れた場合、modelの良さは変わらないためError Variance(赤丸の部分)は変わりません。一方、X2とX1が関連しているため、correlation coefficientは大きくなり、結果として青丸で囲んだ部分は小さくなります。すなわち、β1のvarianceは大きくなることがわかります。

後述のように、このようなX2を”collinear covariate“と呼びます。

β1のstandard errorと検出力

X2挿入後のβ1のvarianceの変化だけでなく、β1のvarianceそのものの値も検出力(power)を考える際には大切になります。なぜなら、β1のvarianceによってt-scoreが計算でき、X1の係数であるβ1のp-valueを求めることができるからです。β1のvarianceが大きいと(t-scoreが小さくなるので)powerが小さくなり、β1のvarianceが小さいと(t-scoreが大きくなるので)powerが大きくなります。

こちらが、X2が、X1やYとどのように関係しているかによって、β1のvariance(そしてstandard error)にどう影響を与えるかをまとめた表です。

X2がX1とYの両方ともに関連している場合(X2がconfounder)、上述のようにβ1のvarianceの計算式の分子・分母両方とも低下させるため、β1のvarianceに与える影響は大きくありません。従って、X2をmodelに加えようが加えなかろうが、(X1とYの関係性に対する)検出力はあまり変わりません。

X2がX1のみに関連している場合(X2がcollinear)、上述のようにβ1のvarianceの計算式の分母のみ低下させ、β1のvarianceは大きくなります。従って、X2をmodelに加えることによって検出力が小さくなります。

そして、X2がYのみにと関連している場合(X2がsignificant predictor)、上述のようにβ1のvarianceの計算式の分子のみ低下させ、β1のvarianceは小さくなります。従って、X2をmodelに加えることによって検出力が大きくなります。

おわりに

今回は、変数が1つしかないsimple regressionから一歩進んで、2つ目の変数があるケースを考えました。これらの知識を踏まえ、次回は、2つ目の変数をmodelに入れるべきかの判断を、統計学的に考える方法を解説します。

Reference

コメント

コメント一覧 (2件)

[…] 統計学的には、predictor (X1)と関係しており、かつoutcome (Y)に独立して関連しているものをconfounderと定義します(上の図のような関係)。そのため、confounderをmodelに加える(adjustする)前後でX1のとYの関係性が変化する、すなわち係数β1が変化します(詳細はこちらを参照してください)。変化率のカットオフとしては、10%や20%がよく使われます。 […]

[…] 線形回帰分析〜その4:第2の変数:変数を追加した際のモデルの変化を見極めることが、多変量解析では重要です。 […]